OAU 「セラヴィ -c’est la vie-」

April, 2023

Concept

「セラヴィ -c’est la vie-」は、風が吹き抜けていくような爽やかさと、どこか懐かしさを感じさせるメロディが印象的で、TOSHI-LOWの哀愁を含んだ優しい歌声がじんわりと心に染み入るようなミディアム・ナンバー。 人々の様々な様相を風に乗って巡っていくという情景から、”人”それぞれが持つ背景、ストーリーを想起させると共に、エモーショナル且つ、ダイナミックに全体を展開しました。 撮影したデータを元にすべてのカットを”NeRF”の画像生成により再構築し、実際撮影したデータが全く違う角度からのダイナミックなカメラ・ワークへ変化させました。 また、”NeRF”特有のノイズをそのまま表現に取り込み、アコースティック・バンド、OAUの持つアンプラグドな世界観をイラストレーションのAR合成と共に表現しました。

The scene of lives passing by on the wind evokes not only the individual backgrounds and stories of people, but also a dynamic and emotional sequence that unfolds as a whole. “C’est la vie” is a medium tempo number that impresses with its refreshing melody that evokes a sense of nostalgia as if the wind is blowing through. TOSHI-LOW’s gentle and melancholic singing gradually seeps into the heart, making you feel serene. Based on the data captured during filming, all shots were reconstructed using “NeRF” image generation, resulting in dynamic camera work from angles that differed from the original footage. Additionally, the unique noise generated by “NeRF” was incorporated into the video, along with AR compositions of illustrations, to express the unplugged world of the acoustic band OAU.

Workflow and Technical details

本作では全編を深層学習を用いたAI画像生成の技術「NeRF」(Neural Radiance Fields)を用いて構築しています。NeRFでは、複数の視点から撮影された画像データとカメラの位置情報を学習リソースとしてニューラルネットワークのAIモデルを構築することで、高い精度で3D空間の形状を復元することが可能です。 撮影したデータを元にすべてのカットを「NeRF」の画像生成により再構築し、実際撮影したデータとは全く違う角度からのダイナミックなカメラワークの映像に仕上げています。

In this work, the entire video was constructed using the AI image generation technology ‘NeRF’ (Neural Radiance Fields) based on deep learning. NeRF can accurately reconstruct the shape of 3D space by constructing an AI model of a neural network using image data captured from multiple viewpoints and camera position information as learning resources. Using the data captured during filming, all shots were reconstructed using NeRF’s image generation to create a video with dynamic camera work from angles different from the original footage.

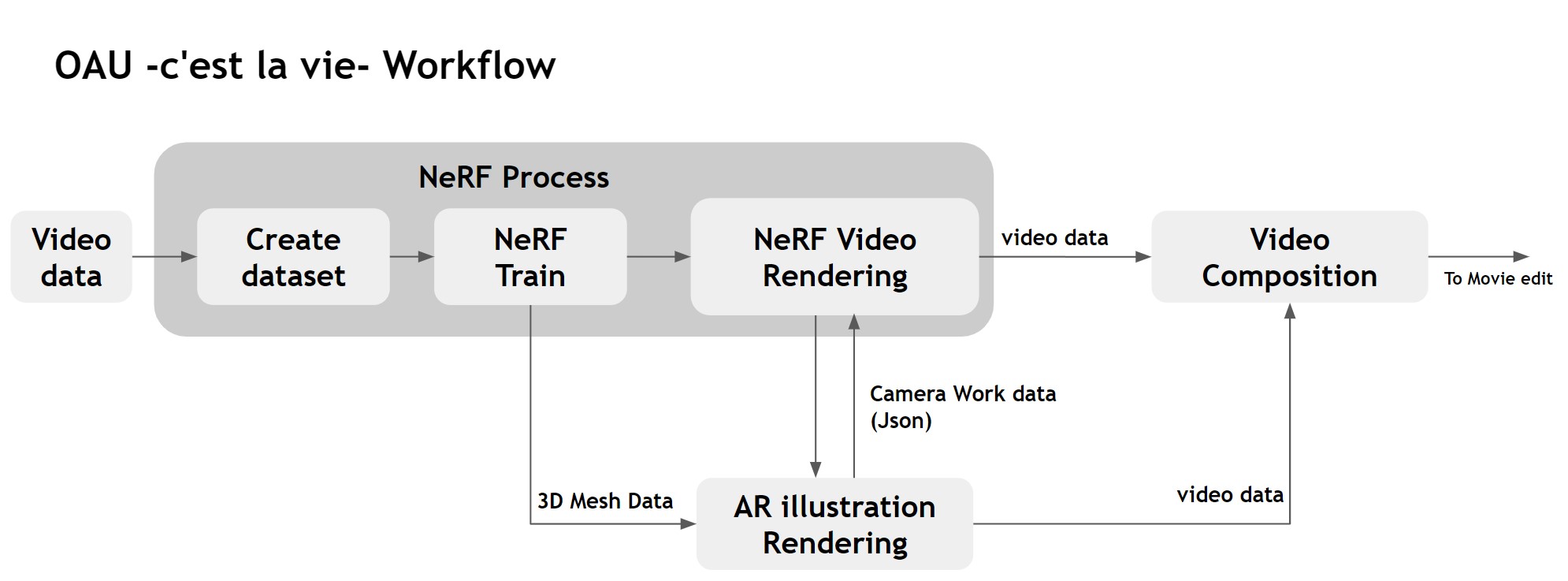

Workflow

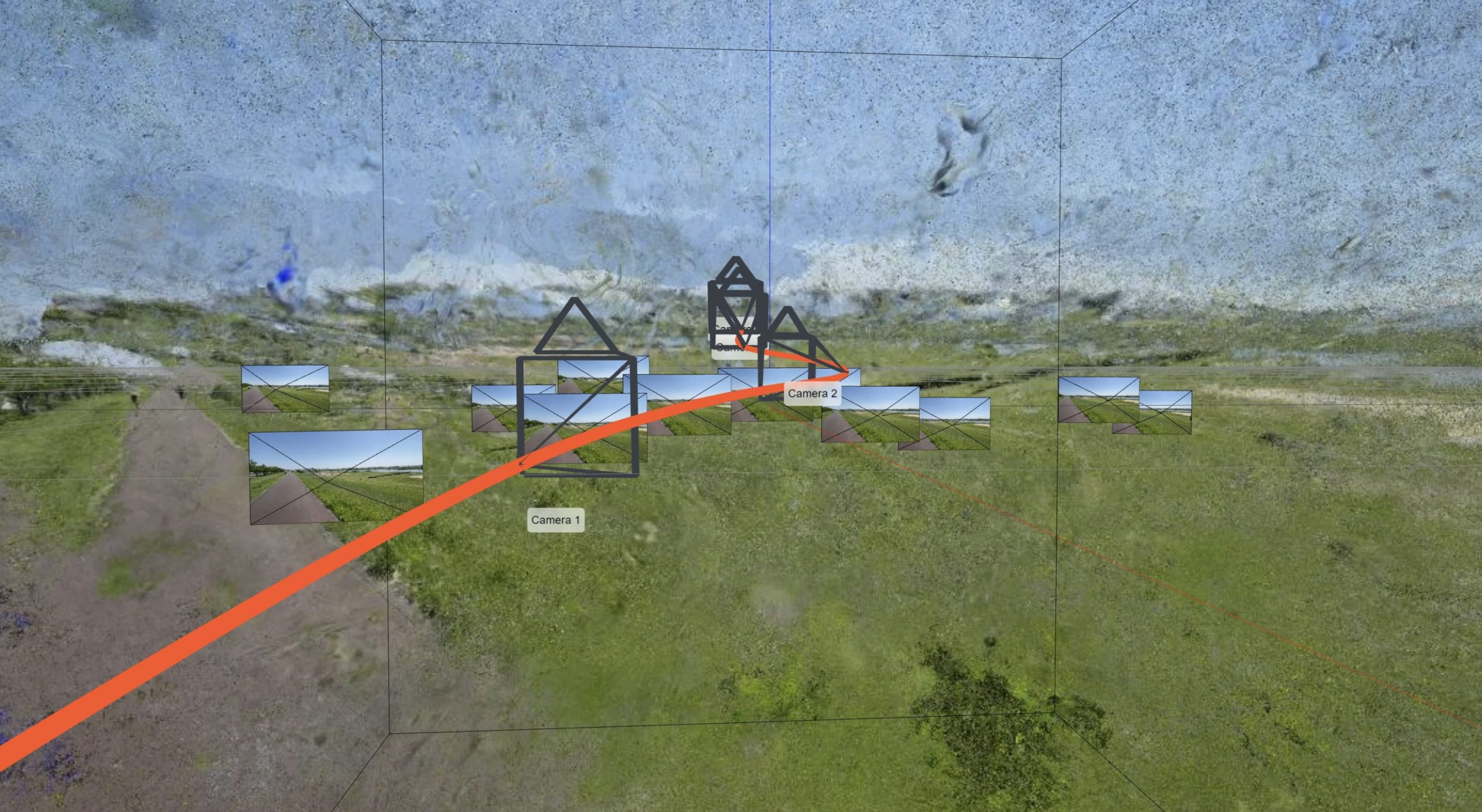

撮影から、NeRF映像生成、イラスト合成、コンポジションまでの独自のワークフロー構築を行い制作を進めました。 NeRFのプロセスで生成されるデータを元に複数のツールを連携させる形をとっています。

We developed a unique workflow for this production, from shooting to NeRF footage generation, illustration compositing, and post-production. We utilized data generated from the NeRF process and coordinated multiple tools to achieve our vision.

NeRF Video Generation

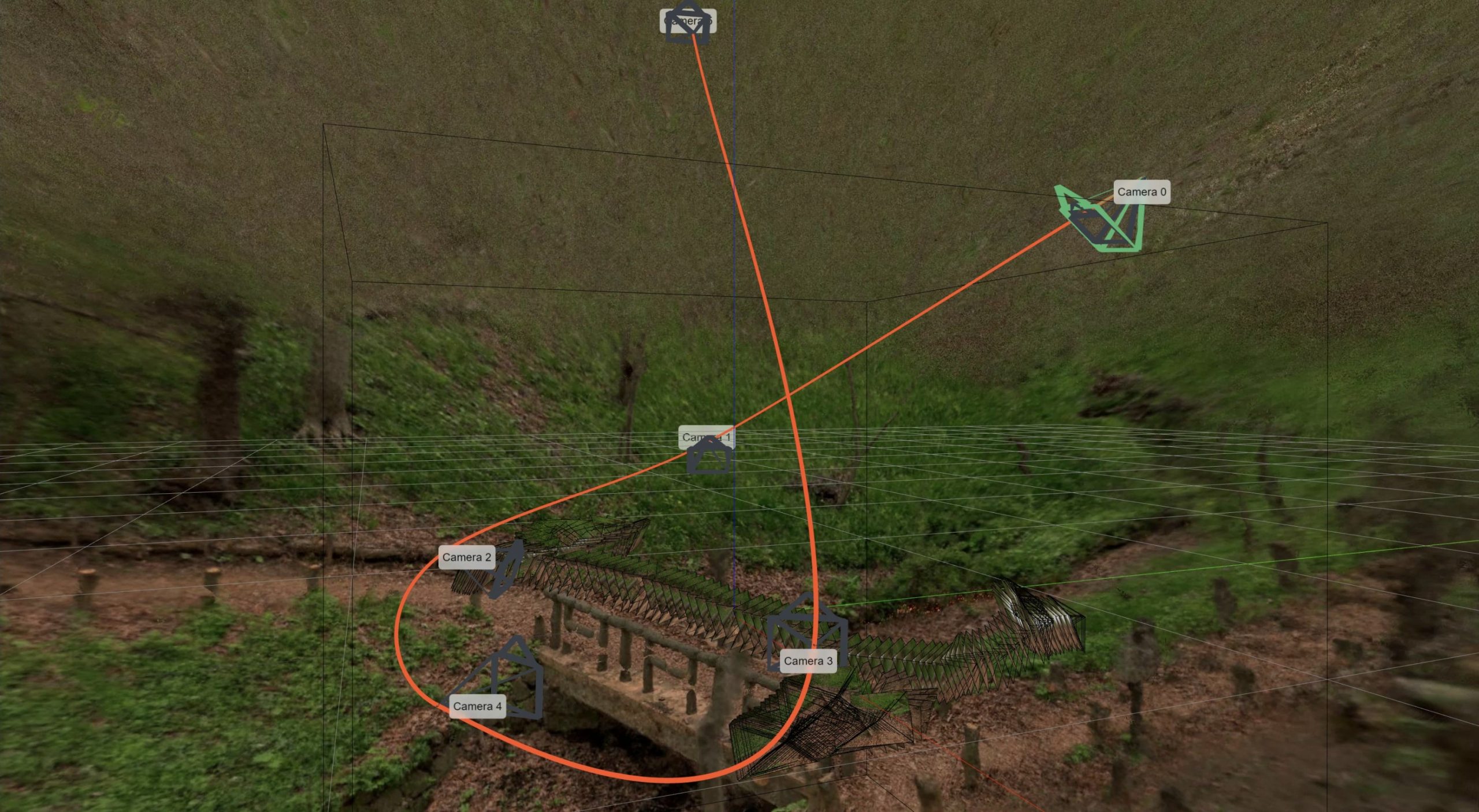

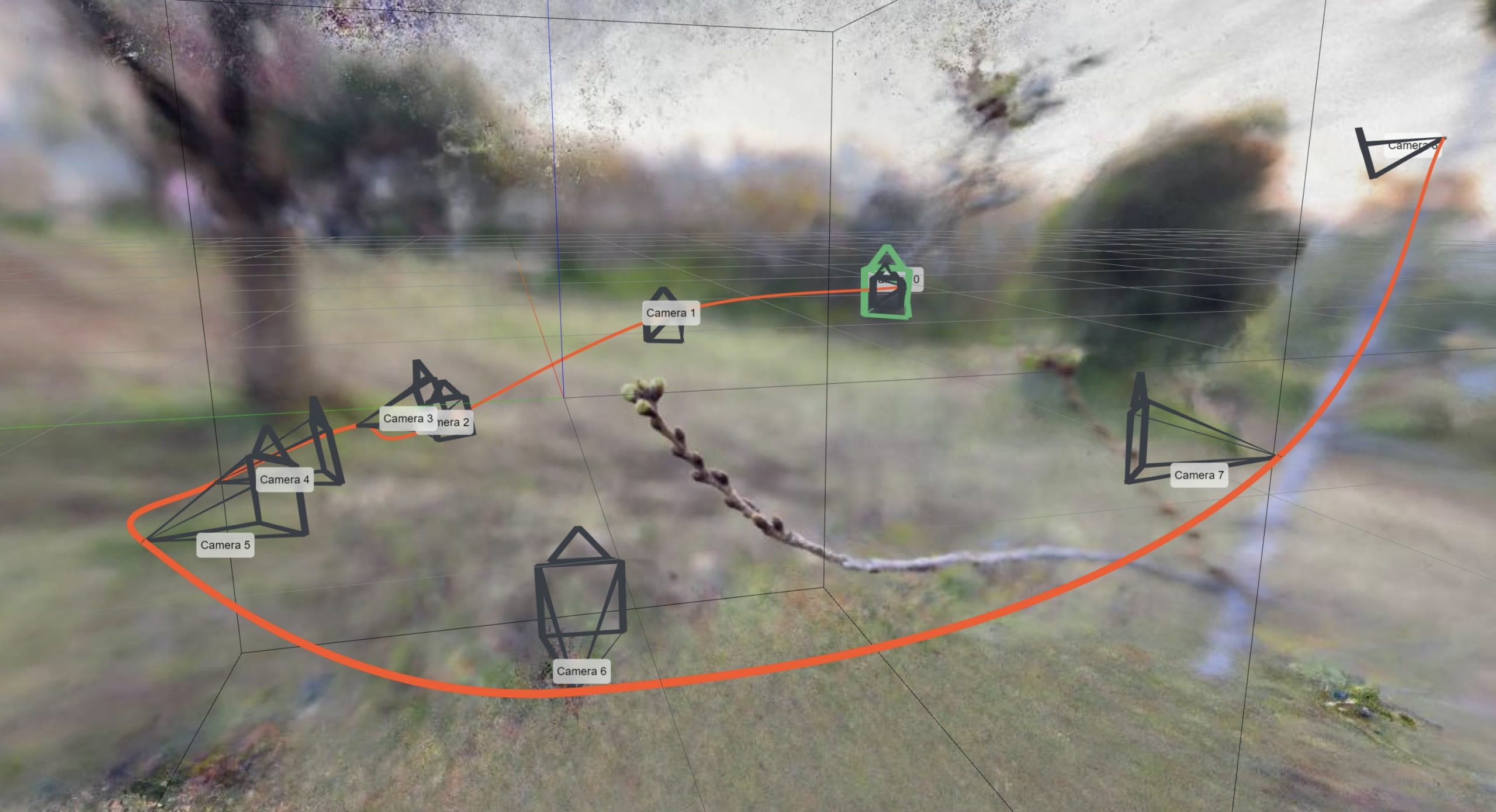

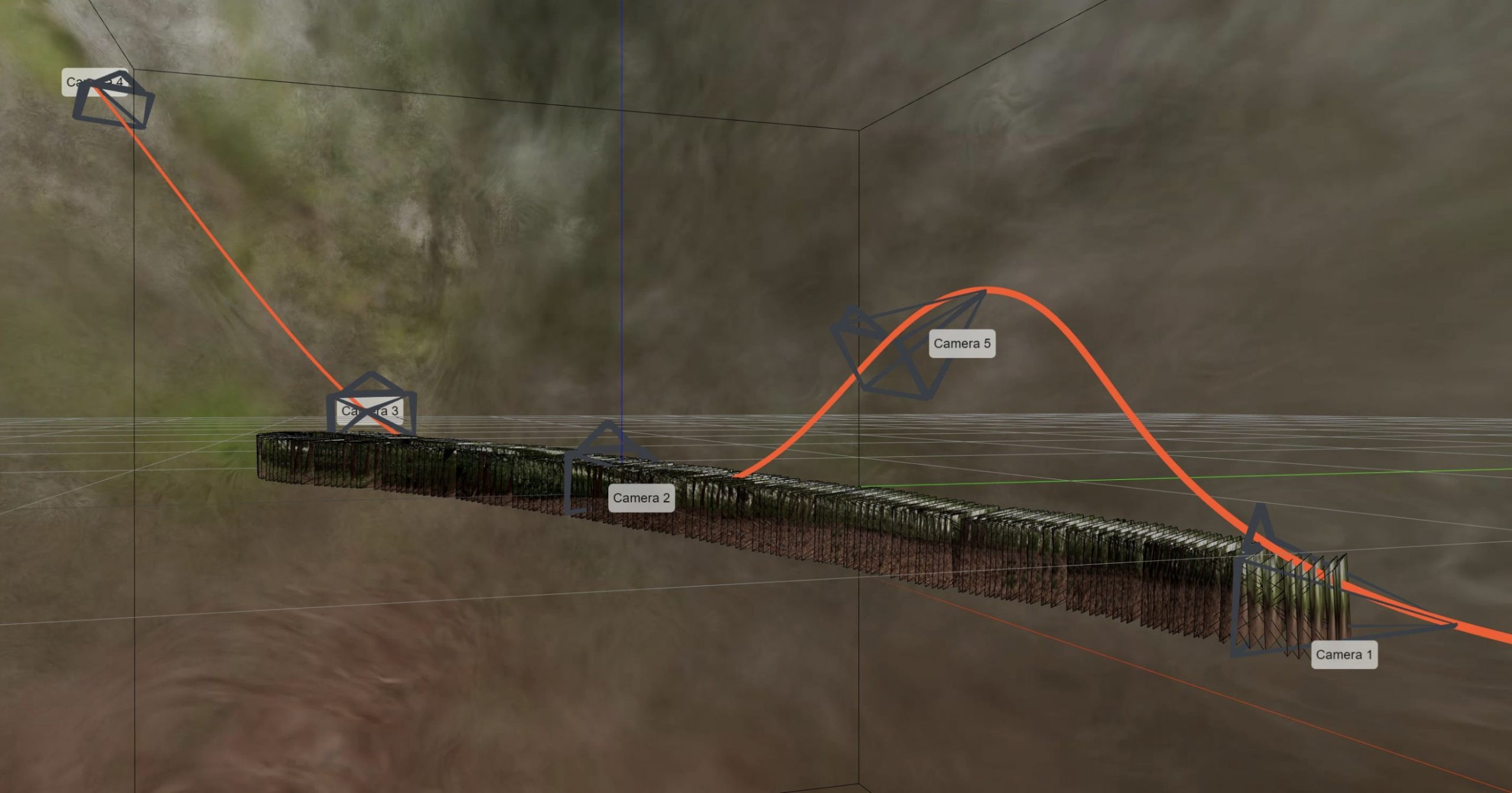

撮影された実写映像データを元に学習させ、カメラワークを設定し全カットNeRF映像として書き出しを行いました。

By using actual footage data captured during filming as a learning resource for NeRF, we set up the camera work and exported the entire sequence as NeRF video.

撮影段階では、カメラワークは未決定のため、3Dデータ上で様々なカメラワークをトライアンドエラーすることで、全体構成と各カットのカメラワークを決定していきました。 「人々の様々な様相を風に乗って巡っていく」という全体構成のコンセプトを実現するために、各カットとの繋ぎも連動性を感じられるようにそれぞれのカットのカメラワークをチューニングしていきました。 NeRFの持ち味である、普通のカメラ撮影では不可能な自由視点からの映像表現を取り入れながら、アコースティックサウンドとの親和性が感じられるスピード感、揺らぎのある印象を目指しました。

During the filming stage, as the camera work was undecided, we determined the overall composition and camera work for each shot by trial and error with various camera angles on 3D data. To bring to life the concept of the overall sequence, which is to show the lives of people passing by on the wind, we fine-tuned the camera work of each shot to ensure smooth transitions between them. As we incorporated the characteristic NeRF visual expression, which is impossible to achieve with traditional camera techniques, we aimed to create an undulating style with a sense of speed that harmonizes with the acoustic sound.

Visual Creation

本作では、NeRFの最大の特徴である自由視点のカメラワークと合わせて、 NeRF特有の雲のようなノイズをそのまま表現に取り込み多数活用しています。

In this work, we have extensively incorporated the unique cloud-like noise characteristic of NeRF into the expression of numerous scenes, in combination with the free viewpoint camera work that is its most prominent feature.

あえて短時間で撮影した情報量が少ない映像データからNeRF生成を行うことで、意図的にノイズを増やし抽象的な絵画のような印象の絵を生み出す等の手法を見出し取り入れました。

We employed various techniques in this project, such as deliberately starting the camera work from a point in 3D space where no recorded footage exists, then directing it towards high-fidelity footage to create the impression of descending from the sky through the clouds. We also utilized NeRF to generate scenes from short, low-data footage, deliberately increasing the noise level to create an impressionistic, painting-like technique that we incorporated into the work.

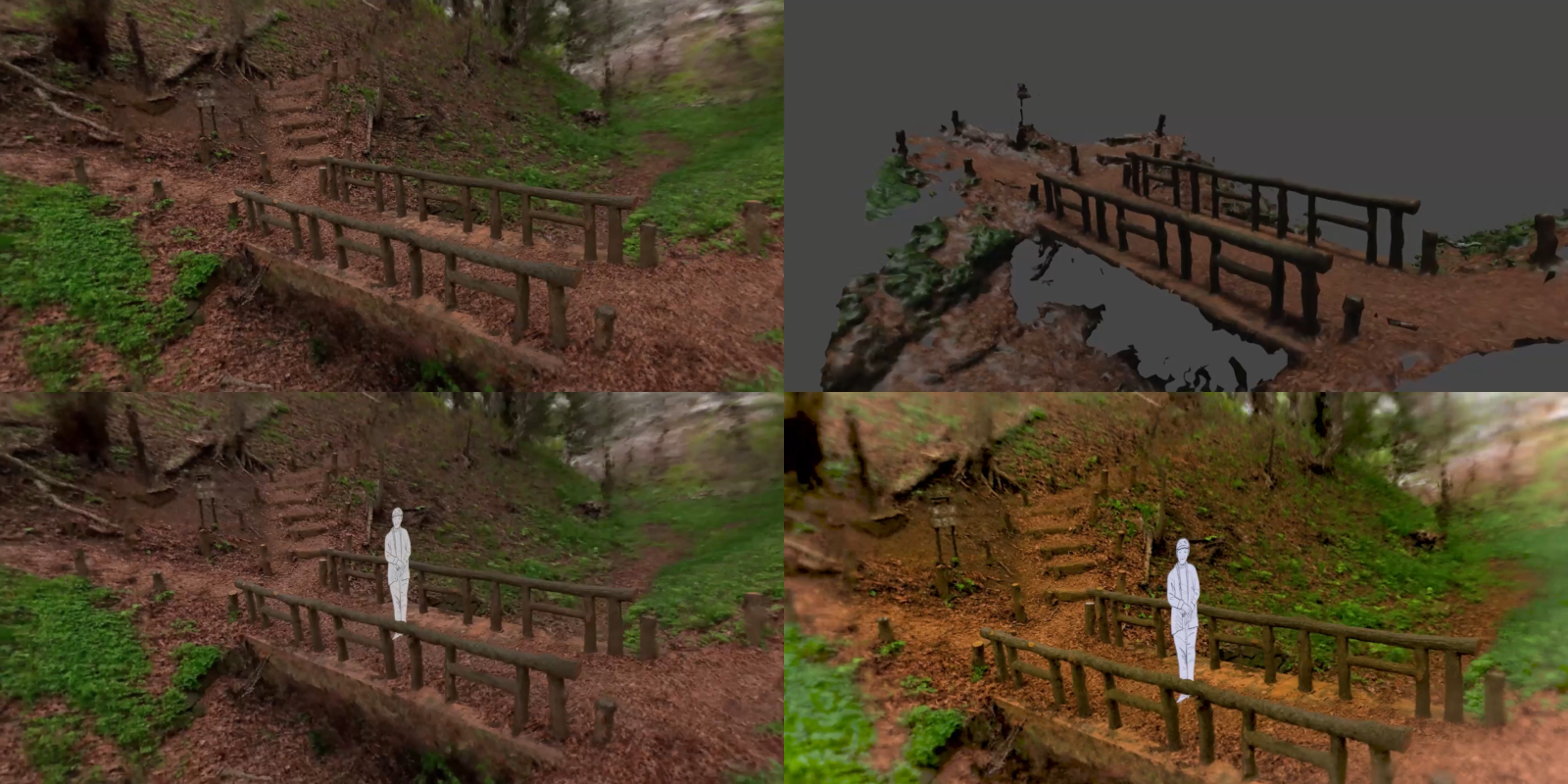

Illustration Compositing

ストーリーの肝となるイラストはNeRF学習時に同時に生成される空間の3Dメッシュデータと、NeRF上で設定しているカメラワークを3DCGツールに取り込み、イラストのAR合成を行いました。 メッシュデータを用いることでオクルージョンの機能も実現しています。

The illustrations, which are a crucial part of the story, were composited using AR technology by incorporating the 3D mesh data of the space generated during NeRF learning and the camera work set in NeRF into a 3DCG tool. The use of mesh data also enabled the realization of occlusion function.

NeRFについて About NeRF

「NeRF」(Neural Radiance Fields)は、2020年に発表された、深層学習を用いたAI画像生成の技術である。 複数の視点から撮影された画像データとカメラの位置情報を学習リソースとしてニューラルネットワークのAIモデルを構築することで、高い精度で3D空間の形状を復元することができる。 この技術を用いることで、元の撮影データには存在しない自由な視点から対象物を見ることが可能となる。 今後は、MR(Mixed Reality)や映画・テレビの特殊効果、医療用の画像処理技術など幅広い分野での応用が期待される。

“NeRF” (Neural Radiance Fields) is a technology for AI image generation using deep learning, which was announced in 2020. NeRF can accurately reconstruct the shape of 3D space by constructing an AI model of a neural network using image data captured from multiple viewpoints and camera position information as learning resources. By using this technology, it is possible to look at a subject matter from any free viewpoints. This technology is expected to have wide applications in various fields, including MR (Mixed Reality), special effects for film and TV, and medical image processing.

Credit

Concept Design,Visual Creation,Movie Edit:Shuhei Matsuyama Technical Direction:Ayato Ohkawara Technical Direction:Shun Sasaguri Technical Direction:maple CG Deisgn:Suihou Matsumoto CG Deisgn:Saki Shiina CG Deisgn:Reon Ogusu Videographer,Editor:Narumi Takakura Production Management:Takumi Ito